Một vụ kiện đã được đệ trình chống lại Apple với cáo buộc công ty cố tình cho phép dịch vụ iCloud lưu trữ tài liệu lạm dụng tình dục trẻ em (CSAM).

Đơn kiện đại diện cho hàng nghìn nạn nhân bị lạm dụng cho rằng sự thiếu hành động của Apple đã gây thêm tổn hại cho các nạn nhân.

Nguyên đơn trong vụ kiện là một phụ nữ 27 tuổi, người đã phải chịu đựng sự lạm dụng từ khi còn nhỏ. Cô cho biết một người họ hàng đã quấy rối, ghi lại cảnh ngược đãi và chia sẻ hình ảnh trực tuyến. Cô cũng nhận được thông báo từ cơ quan thực thi pháp luật về việc phát hiện những hình ảnh này trên nhiều thiết bị, trong đó có một thiết bị lưu trữ trên iCloud của Apple.

Apple từng nỗ lực chống CSAM nhưng lại từ bỏ

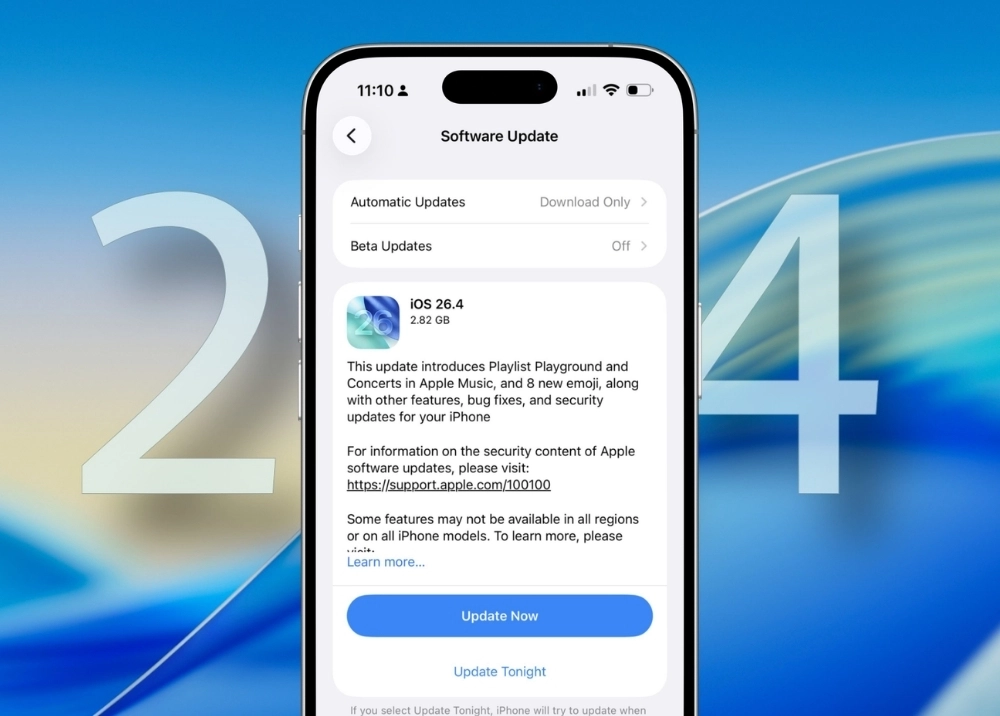

Vụ kiện nhấn mạnh những nỗ lực trước đây của Apple trong việc phát hiện CSAM trên iCloud. Vào tháng 8 năm 2021, công ty đã công bố tính năng “Phát hiện CSAM”, sử dụng công nghệ NeuralHash để xác định các hình ảnh lạm dụng đã biết. Tuy nhiên, do lo ngại về quyền riêng tư và khả năng bị lạm dụng, Apple đã quyết định từ bỏ chương trình này.

Theo vụ kiện, quyết định từ bỏ tính năng phát hiện CSAM của Apple thể hiện sự coi thường đối với sự an toàn của trẻ em. “Thay vì sử dụng các công cụ mà họ đã phát triển để xác định, xóa và báo cáo hình ảnh lạm dụng, Apple đã cho phép tài liệu đó lan truyền, khiến các nạn nhân phải sống lại những chấn thương đã định hình cuộc sống của họ”, nội dung vụ kiện nêu rõ.

Mục tiêu của vụ kiện không chỉ là buộc Apple thực hiện các biện pháp mạnh mẽ để ngăn chặn việc lưu trữ và phân phối CSAM trên nền tảng của mình mà còn nhằm bồi thường cho 2.680 nạn nhân tiềm năng có thể đủ điều kiện tham gia vụ kiện.