NVIDIA đang giữ vị thế thống lĩnh trong thị trường bộ tăng tốc AI, với các sản phẩm đòi hỏi bộ nhớ băng thông cao (HBM) có dung lượng lớn. Hiện tại, SK Hynix là nhà cung cấp chính cho nhu cầu này, trong khi Samsung vẫn đang trong quá trình chờ phê duyệt cho các chip HBM3E của họ.

Song song với diễn biến trên, nguồn tin cho biết Samsung và NVIDIA đang có những cuộc thảo luận kín về việc thương mại hóa một công nghệ bộ nhớ AI tiên tiến mới có tên SOCAMM (System on Chip Advanced Memory Module – Mô-đun bộ nhớ tiên tiến tích hợp trên chip). Đáng chú ý, NVIDIA cũng được cho là đang tiến hành đàm phán tương tự với SK Hynix về công nghệ này.

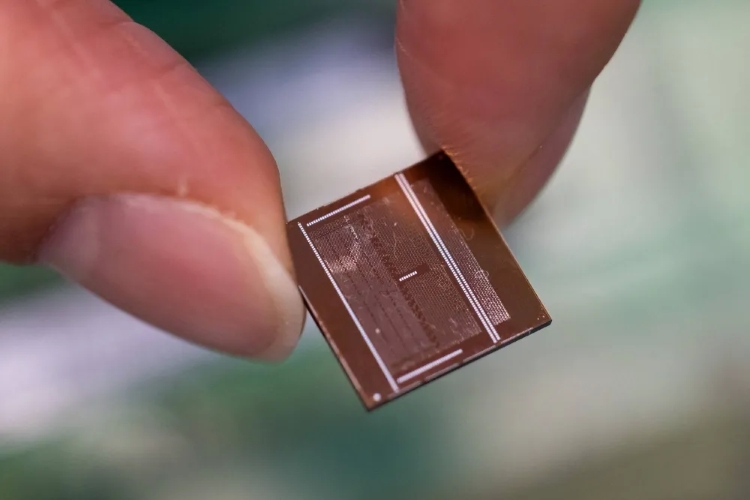

NVIDIA đang trong quá trình đánh giá các nguyên mẫu SOCAMM

Tiêu chuẩn bộ nhớ mới SOCAMM đang được thảo luận tích cực về khả năng thương mại hóa. Giới công nghiệp đánh giá đây là bước tiến quan trọng so với các chip nhớ băng thông cao hiện tại – vốn đóng vai trò then chốt trong các bộ tăng tốc AI.

Với thiết kế hướng đến việc nâng cao hiệu suất của các siêu máy tính AI, SOCAMM mang đến tỷ lệ hiệu suất-chi phí vượt trội. Kiến trúc mô-đun với số lượng cổng kết nối đa dạng giúp giải quyết hiệu quả vấn đề tắc nghẽn dữ liệu – một thách thức lớn trong lĩnh vực điện toán AI.

Ưu điểm nổi bật của SOCAMM là khả năng tháo lắp linh hoạt, cho phép các trung tâm dữ liệu dễ dàng nâng cấp và thay thế các mô-đun bộ nhớ. Thiết kế nhỏ gọn cũng tối ưu hóa không gian lắp đặt, từ đó tăng cường đáng kể năng lực tính toán hiệu suất cao.

Theo nguồn tin từ các chuyên gia ngành, NVIDIA cùng các nhà sản xuất bộ nhớ như Samsung đang tích cực phát triển và thử nghiệm hiệu suất các nguyên mẫu SOCAMM. Dự kiến quá trình sản xuất hàng loạt sẽ bắt đầu trước cuối năm 2025.

Sự phát triển này có thể tạo cơ hội để Samsung lấy lại thị phần trong lĩnh vực bộ nhớ băng thông cao mà trước đây đã bị SK Hynix chiếm lĩnh.